Se você receber suas notícias da mídia social, como a maioria dos americanos faz, você está exposto a uma dose diária de fraudes, rumores, teorias da conspiração e notícias enganosas. Quando tudo está misturado com informações confiáveis de fontes honestas, a verdade pode ser muito difícil de discernir.

Na verdade, a análise de dados da minha equipe de pesquisa da Universidade de Columbia Emergente rumores rastreador sugere que isso desinformação é tão provável que se torne viral como informação confiável.

Muitos estão perguntando se esse ataque de desinformação digital afetou o resultado da eleição dos EUA 2016. A verdade é que não sabemos, embora haja razões para acreditar que é inteiramente possível, com base em análise passada e contas de outros países. Cada pedaço de desinformação contribui para a formação de nossas opiniões. No geral, o dano pode ser muito real.

Como pesquisadora sobre a disseminação de desinformação através das mídias sociais, eu sei que limitar a capacidade dos jornalistas de vender anúncios, como recentemente anunciou Google e Facebooké um passo na direção certa. Mas não reprimirá os abusos motivados por motivos políticos.

Explorando a mídia social

Sobre a 10 anos atrás, meus colegas e eu dirigimos experimentar em que nós aprendemos 72 por cento de estudantes universitários confiáveis links que pareciam originar de amigos - até ao ponto de inserir informações pessoais de login em sites de phishing. Essa vulnerabilidade generalizada sugeriu outra forma de manipulação maliciosa: as pessoas também podem acreditar em desinformação que recebem ao clicar em um link de um contato social.

Para explorar essa ideia, criei um página da web falsa com notícias de fofocas aleatórias, geradas por computador - coisas como “Celebrity X pego na cama com Celebrity Y!” Os visitantes do site que procuravam por um nome acionariam o script para automaticamente fabricar uma história sobre a pessoa. Eu incluí no site um aviso, dizendo que o site continha texto sem sentido e "fatos" inventados. Eu também coloquei anúncios na página. No final do mês, recebi um cheque pelo correio com ganhos dos anúncios. Essa foi a minha prova: notícias falsas poderiam ganhar dinheiro ao poluir a internet com falsidades.

Infelizmente, eu não fui o único com essa ideia. Dez anos depois, nós temos um indústria de notícias falsas e desinformação digital. Os sites Clickbait fabricam hoaxes para ganhar dinheiro com anúncios, enquanto os chamados sites hiperpartidários publicam e espalham rumores e teorias conspiratórias para influenciar a opinião pública.

Esta indústria é reforçada por quão fácil é criar bots sociaiscontas falsas controladas por software que se parecem com pessoas reais e, portanto, podem ter uma influência real. Pesquisa na minha laboratório descobriu muitos exemplos de campanhas falsas de base, também chamadas astroturfing político.

Em resposta, desenvolvemos o BotOrNot ferramenta para detectar bots sociais. Não é perfeito, mas preciso o suficiente para descobrir campanhas de persuasão nos movimentos Brexit e antivax. Usando BotOrNot, nossos colegas descobriram que um grande parte de conversa online sobre as eleições 2016 foi gerada por bots.

Criando bolhas de informação

Nós humanos somos vulneráveis à manipulação por desinformação digital graças a um conjunto complexo de vieses sociais, cognitivos, econômicos e algorítmicos. Algumas delas evoluíram por boas razões: Confiar nos sinais de nossos círculos sociais e rejeitar informações que contradizem nossa experiência nos serviu bem quando nossa espécie se adaptou para fugir de predadores. Mas nas redes on-line de hoje, uma conexão de rede social com um teórico da conspiração do outro lado do planeta não ajuda a informar minhas opiniões.

Copiar nossos amigos e deixar de seguir os que têm opiniões diferentes nos dão câmaras de eco. polarizada que os pesquisadores podem dizer com alta precisão se você é liberal ou conservador apenas olhando para seus amigos. A estrutura da rede é tão denso que qualquer desinformação se espalha quase instantaneamente dentro de um grupo e tão segregada que não atinge o outro.

Dentro de nossa bolha, somos seletivamente expostos a informações alinhadas com nossas crenças. Esse é um cenário ideal para maximizar o engajamento, mas prejudicial para o desenvolvimento de um ceticismo saudável. Viés de confirmação nos leva a compartilhar um título sem ler o artigo.

Nosso laboratório recebeu uma lição pessoal disso quando nosso projeto de pesquisa se tornou assunto de campanha de desinformação viciosa no período que antecede as eleições para os EUA da 2014. Quando investigamos o que estava acontecendo, encontramos notícias falsas sobre nossa pesquisa sendo predominantemente compartilhadas por usuários do Twitter dentro de uma câmara de eco partidária, uma comunidade grande e homogênea de usuários politicamente ativos. Essas pessoas foram rápidas em retuitar e impermeáveis a desmascarar informações.

Inevitabilidade viral

Nossa pesquisa mostra que, dada a estrutura de nossas redes sociais e nossa atenção limitada, é inevitável que alguns memes vai viral, independentemente da sua qualidade. Mesmo que os indivíduos tendam a compartilhar informações de maior qualidade, a rede como um todo não é eficaz em discriminar informações confiáveis e fabricadas. Isso ajuda a explicar todas as fraudes virais que observamos na natureza.

A economia de atenção cuida do resto: Se prestarmos atenção a um determinado tópico, mais informações sobre esse tópico serão produzidas. É mais barato fabricar informações e passá-las como fatos do que relatar a verdade real. E a fabricação pode ser adaptada a cada grupo: os conservadores leram que o papa endossou Trump, liberais leram que ele endossou Clinton. Ele não fez nem.

Em agradecimento a algoritmos

Como não podemos prestar atenção a todas as postagens em nossos feeds, os algoritmos determinam o que vemos e o que não vemos. Os algoritmos usados pelas plataformas de mídia social hoje são projetados para priorizar postagens interessantes - aquelas com as quais provavelmente clicaremos, reagiremos e compartilharemos. Mas uma análise recente encontrou páginas intencionalmente enganosas, pelo menos tanto compartilhamento online e reação como uma notícia real.

Essa tendência algorítmica em relação ao envolvimento sobre a verdade reforça nossos vieses sociais e cognitivos. Como resultado, quando seguimos links compartilhados em mídias sociais, tendemos a visitar um site menor, mais homogêneo conjunto de fontes do que quando realizamos uma pesquisa e visitamos os principais resultados.

A pesquisa existente mostra que estar em uma câmara de eco pode fazer as pessoas mais crédulo sobre aceitar rumores não verificados. Mas precisamos saber muito mais sobre como pessoas diferentes respondem a uma única farsa: algumas compartilham imediatamente, outras verificam primeiro.

Nós somos simulando uma rede social para estudar essa competição entre compartilhamento e checagem de fatos. Esperamos ajudar a desvendar evidências conflitantes sobre quando a checagem de fatos ajuda a impedir fraudes de se espalhar e quando isso não acontece. Nossos resultados preliminares sugerem que quanto mais segregada a comunidade de crentes, mais a fraude sobrevive. Novamente, não se trata apenas do trote em si, mas também da rede.

Muitas pessoas estão tentando descobrir o que fazer sobre tudo isso. De acordo com o mais recente de Mark Zuckerberg anúncio, As equipes do Facebook estão testando possíveis opções. E um grupo de estudantes universitários propôs uma maneira de simplesmente rotular links compartilhados como “verificado” ou não.

Algumas soluções permanecem fora do alcance, pelo menos por enquanto. Por exemplo, ainda não podemos ensinar sistemas de inteligência artificial como discernir entre verdade e falsidade. Mas podemos dizer algoritmos de classificação para dar maior prioridade a fontes mais confiáveis.

Estudando a disseminação de notícias falsas

Nós podemos tornar a nossa luta contra as notícias falsas mais eficiente se entendermos melhor como as informações ruins se espalham. Se, por exemplo, bots são responsáveis por muitas das falsidades, podemos nos concentrar em detectá-las. Se, alternativamente, o problema é com as câmaras de eco, talvez possamos projetar sistemas de recomendação que não excluam visões diferentes.

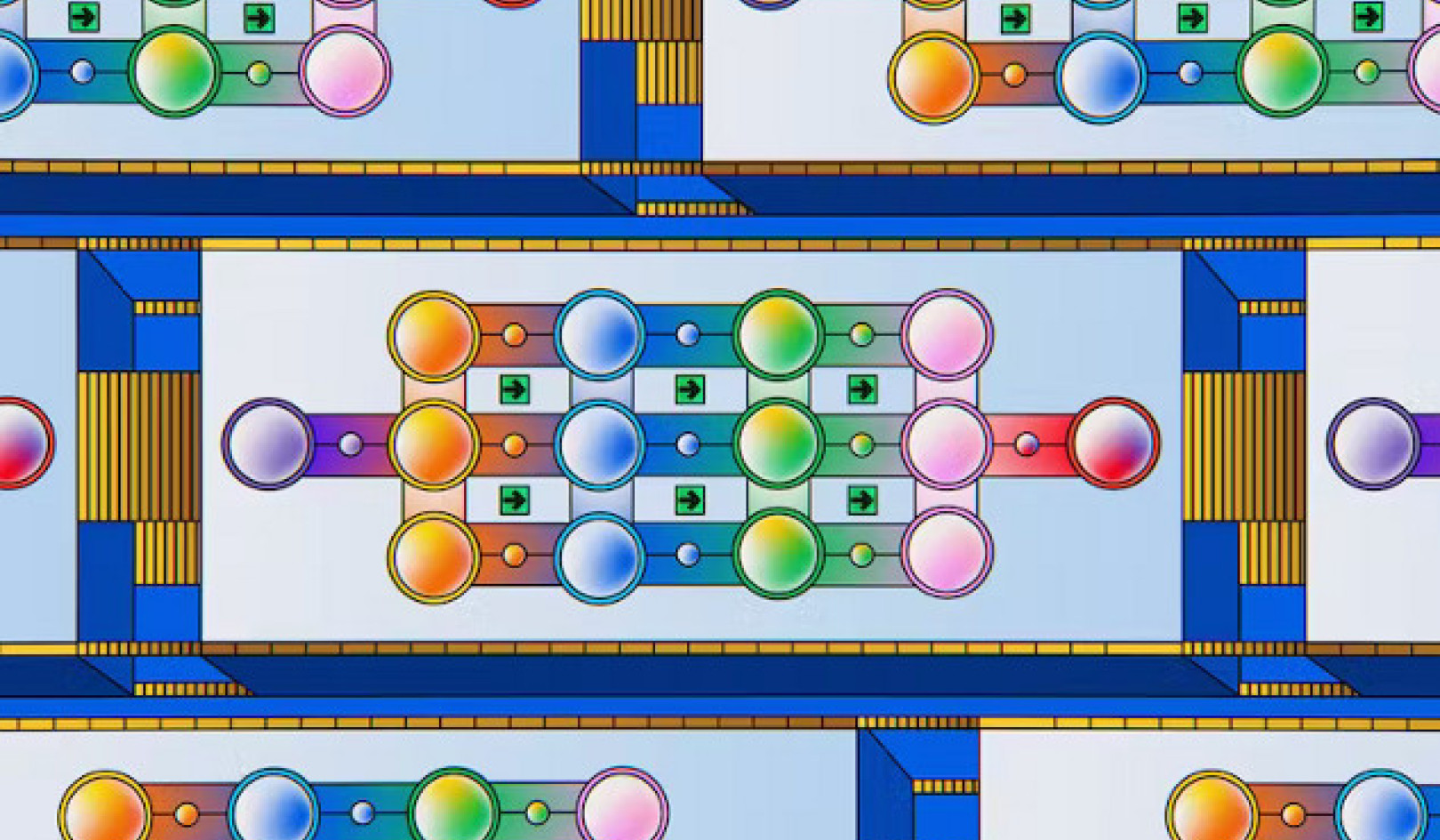

Para esse fim, nosso laboratório está construindo uma plataforma chamada Hoaxy para acompanhar e visualizar a disseminação de alegações não verificadas e a correspondente verificação de fatos nas mídias sociais. Isso nos dará dados do mundo real, com os quais podemos informar nossas redes sociais simuladas. Então podemos testar possíveis abordagens para combater notícias falsas.

O Hoaxy também pode mostrar às pessoas como é fácil que suas opiniões sejam manipuladas por informações on-line - e até mesmo a probabilidade de alguns de nós compartilharem falsidades online. Hoaxy vai se juntar a um conjunto de ferramentas em nossa Observatório de Mídias Sociais, que permite a qualquer um ver como os memes se espalham no Twitter. Vincular ferramentas como essas a verificadores de fatos humanos e plataformas de mídia social pode facilitar a duplicação de esforços e ajuda entre si.

É imperativo que invistamos recursos no estudo deste fenômeno. Precisamos de todas as mãos no convés: cientistas da computação, cientistas sociais, economistas, jornalistas e parceiros da indústria devem trabalhar juntos manter-se firme contra a disseminação de desinformação.

![]()

Sobre o autor

Filippo Menczer, professor de Ciência da Computação e Informática; Diretor do Centro de Redes Complexas e Pesquisa de Sistemas, Universidade de Indiana, Bloomington

Este artigo foi originalmente publicado em A Conversação. Leia o artigo original.

Livros relacionados:

at InnerSelf Market e Amazon